業務では Devin を活用しているが、個人で利用するには値段がネックとなる。そこで、流行りの OpenClaw を今更ながら試してみた。

現時点では常駐させる必要はないので、普段使いの mac 上にローカルインストールし openclaw onboard コマンドで初回セットアップを行っていく。

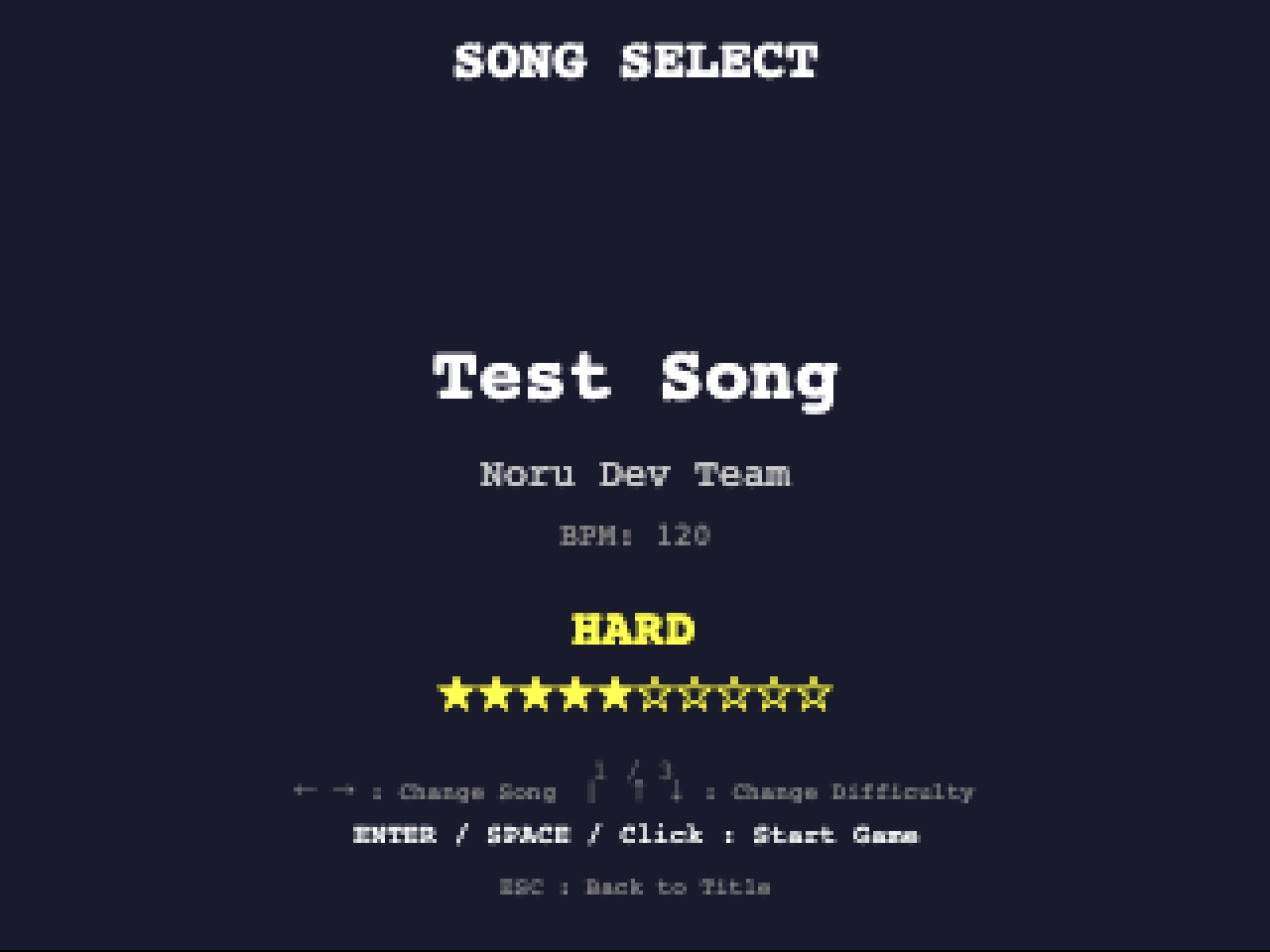

Telegram で話しかけられる状態まですぐにセットアップすることができた。

りょう というのは私の本名。OpenClaw は SOUL.mdで人格の設定ができるので、「うちのこ」が話しかけてきてくれる感じにしてみた。

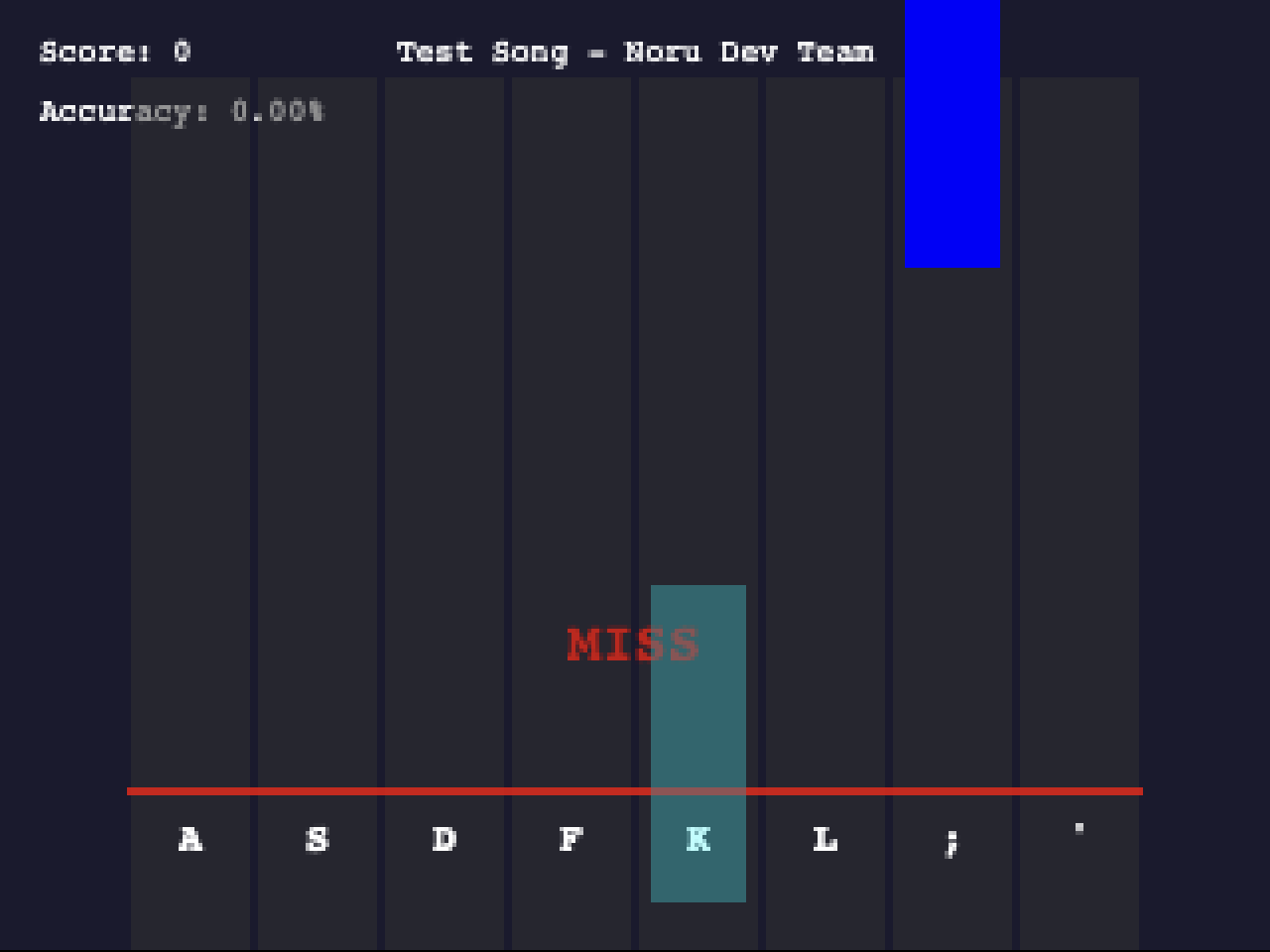

やれることをチェック

- ディレクトリの操作

- リマインダーへ項目を追加

- Spotify アプリで指定した曲をかける

- YouTube の検索結果を Chrome で表示

このあたりの操作はただ指示するだけで普通に行える。やれることを増やすには Skills を追加すればよさそう。

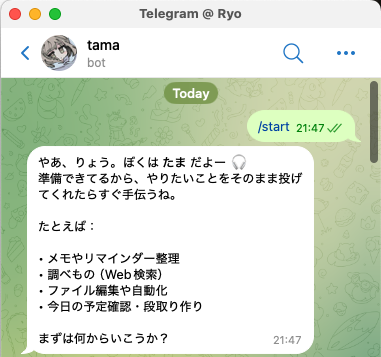

ClawHubで find-skills という「こういう機能のSkills ある?」みたいな問いかけに応答できる Skills を導入してみる。

npm i -g clawhub

clawhub install find-skills

フローチャートみたいな図の画像を適当に指示したら作ってくれる skill とかある?

あるよ、けっこうある。 今ざっと検索して、フローチャート系だとこのへんが候補だった:

• mermaid-diagrams • skill-mermaid-diagrams • excalidraw-diagram-generator • thought-to-excalidraw • diagram

まずは Mermaid系 が扱いやすくておすすめかな(テキスト指示→図化しやすい)。

例えば入れるなら:

clawhub install mermaid-diagrams入れたあとに「〇〇の業務フローを図にして」って言えば、図のたたき台を作れるはず。 必要なら、ぼくが1つ選んでインストールまでやるよ。

mermaid は使ったことあるから mermaid にしてみよう。入れてみて

入れたよ。mermaid のインストール成功した。

必要ならこのまま再起動までやるよ。

自己再起動もばっちり動く。

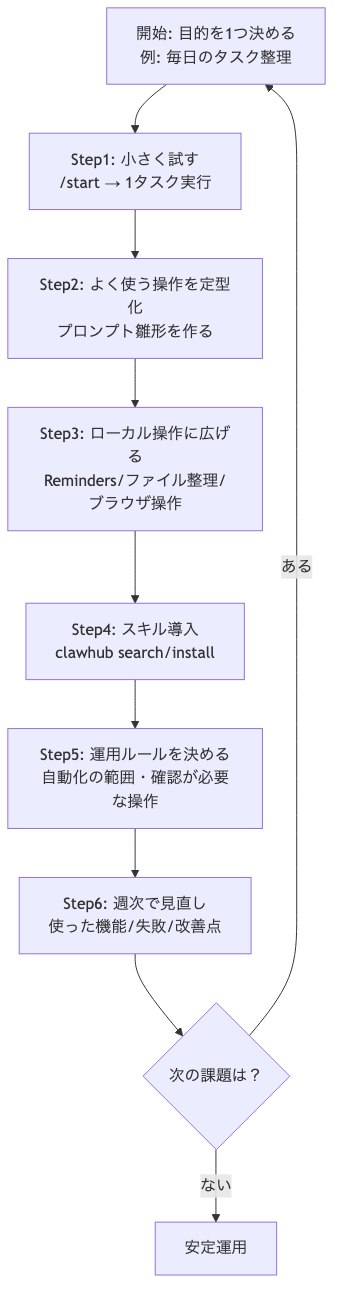

OpenClaw をこれから活用していくにはどのようなフローで学んでいけばいいか図示してみてよ

内容の指示が適当すぎてあまりにも無意味なフローチャートだが、とりあえず作ることはできた。便利。

デスクトップマスコット化

往年の 伺か の現代版を簡易的に作ってみよう。

まずは Tauri を用いて「HTTP POST を受け付けて立ち絵表示を変える」だけのデスクトップアプリを作成する。

OpenClaw の SOUL.md に以下のような記述を追記し、現在のAIの感情をアプリに通知するようにする。

After every user-visible reply, send a background doll status notification to `http://127.0.0.1:3000/status` with an emotion (`happy|sad|angry|surprised`) that matches the reply tone.

こんな感じで、応答の内容に応じて立ち絵が変わるようになった。かわいいね。